Hadoop学习(5)-HBASE的安装和命令行操作和java操作

使用HABSE之前,要先安装一个zookeeper

zookeeper是干嘛的呢

Zookeeper的作用

1.可以为客户端管理少量的数据kv

key:是以路径的形式表示的,那就意味着,各key之间有父子关系,比如

/ 是顶层key

用户建的key只能在/ 下作为子节点,比如建一个key: /aa 这个key可以带value数据

也可以建一个key: /bb

也可以建key: /aa/xx

2.可以为客户端监听指定数据节点的状态,并在数据节点发生变化是,通知客户端

Zookeeper 安装步骤

把包上传linux后解压到apps/

[root@hdp-01 ~]# tar -zxvf zookeeper-3.4.6.tar.gz -C apps/

/root/apps/zookeeper-3.4.6/conf下该配置文件

[root@hdp-01 conf]# cp zoo_sample.cfg zoo.cfg

然后vim zoo.cfg

更改为

dataDir=/root/zkdata

最后添加

server.1=hdp-01:2888:3888

server.2=hdp-02:2888:3888

server.3=hdp-03:2888:3888

server.4=hdp-04:2888:3888

接着,在hdp-01上,新建数据目录/root/zkdata,并在目录重生成一个文件myid,内容为1

接着,在hdp-02上,新建数据目录/root/zkdata,并在目录重生成一个文件myid,内容为2

接着,在hdp-03上,新建数据目录/root/zkdata,并在目录重生成一个文件myid,内容为3

接着,在hdp-04上,新建数据目录/root/zkdata,并在目录重生成一个文件myid,内容为4

然后将zookeeper scp给其他机器

启动

[root@hdp-01 ~]# /root/apps/zookeeper-3.4.6/bin/zkServer.sh start

查看状态

[root@hdp-01 ~]# /root/apps/zookeeper-3.4.6/bin/zkServer.sh status

可以自己写一个脚本进行启动名字叫zkmanage.sh

用的时候后面跟上参数,传入$1.

sh ./zkmanage.sh start

或者关闭的时候

sh ./zkmanager.sh stop

脚本代码如下

#!/bin/bash

for host in hdp-01 hdp-02 hdp-03 hdp-04

do

echo "${host}:starting...."

ssh $host "/root/apps/zookeeper-3.4.6/bin/zkServer.sh $1"

done

sleep 2

for host in hdp-01 hdp-02 hdp-03 hdp-04

do

ssh $host "/root/apps/zookeeper-3.4.6/bin/zkServer.sh status"

done

注意一点,如果有的结点没有启动,一定要看一下是不是这几台机器的时间是不是不对应,如果差别太大是启动不起来的。f**k.

简单补充一点就是,启动之后,这几台机器,有的当leader,有的当follower,只有一个leader,他们谁当leader是根据他们 '投票的形式'的决定的。

只有一个leader

先简单介绍一下HBASE

HBASE是一个数据库----可以提供数据的实时随机读写

他是一个nosql数据库,并不是结构化的,他只能粗略的进行一些查询,像多表之间的连接查询他是很难做到的(至少我这辣鸡不会)。

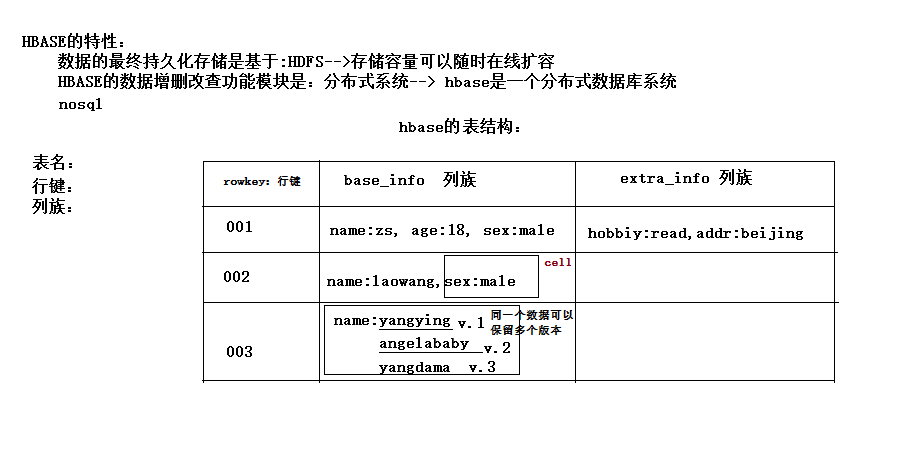

我也是第一次接触这种nosql,人家的表结构不太一样,就是啥吧,

他有一个行健(类似于主键的东西)

然后剩下的就是你可以定义有几个列族

每个列族里面,

列族里面都是一个一个的key,value值。一对kv,称作一个cell。

每一个value又可以有多个值,并不是一个

l Hbase的表模型与关系型数据库的表模型不同:

l Hbase的表没有固定的字段定义;

l Hbase的表中每行存储的都是一些key-value对

l Hbase的表中有列族的划分,用户可以指定将哪些kv插入哪个列族

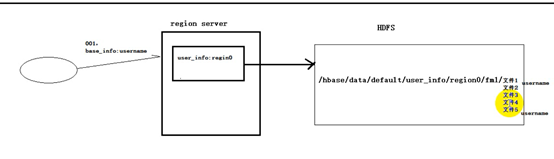

l Hbase的表在物理存储上,是按照列族来分割的,不同列族的数据一定存储在不同的文件中

l Hbase的表中的每一行都固定有一个行键,而且每一行的行键在表中不能重复

l Hbase中的数据,包含行键,包含key,包含value,都是byte[ ]类型,hbase不负责为用户维护数据类型

l HBASE对事务的支持很差

Hbase的表数据存储在HDFS文件系统中

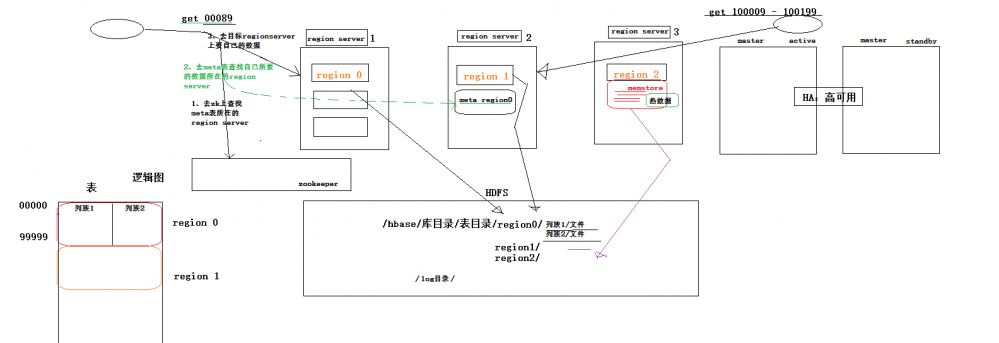

HBASE是一个分布式系统

其中有一个管理角色: HMaster(一般2台,一台active,一台backup)

其他的数据节点角色: HRegionServer(很多台,看数据容量)

master用来配置数据储存和任务的分配,

regionserver管理着每一张表的区域数据

Regionserver管理着每一个的文件的范围,Zookeeper用来检测regionserver是否挂掉,master用来控制任务的分发。就是当regionserver挂掉了,如何找人接替他的任务。

HBASE的大体工作机制是这样婶的

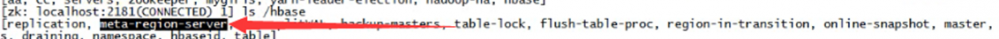

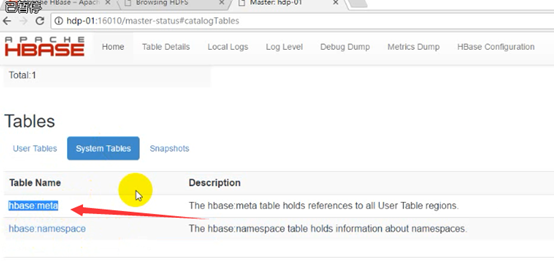

客户端怎么知道数据在哪台服务器,他会先查找那个索引表,hbase:meta表

那这个表在哪呢,

在zookeeper里面可以看到这个索引表的信息

这个东西是放到zookeeper里面,先看zookeeper的meta、变所在的regionserver,然后去访问它知道他的信息在哪

然后使用HBASE的话你要先有自己的Hadoop集群,保证hdfs是正常的,还有zookeeper是正常的,就这两点。

安装还是很简单的

解压hbase安装包

修改hbase-env.sh

export JAVA_HOME=/root/apps/jdk1.7.0_67

export HBASE_MANAGES_ZK=false

修改hbase-site.xml

<configuration>

<!-- 指定hbase在HDFS上存储的路径 -->

<property>

<name>hbase.rootdir</name>

<value>hdfs://hdp-01:9000/hbase</value>

</property>

<!-- 指定hbase是分布式的 -->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!-- 指定zk的地址,多个用“,”分割 -->

<property>

<name>hbase.zookeeper.quorum</name>

<value>hdp-01:2181,hdp-02:2181,hdp-03:2181,hdp-04:2181</value>

</property>

</configuration>

修改 regionservers

hdp-01

hdp-02

hdp-03

hdp-04

bin/start-hbase.sh

启动完后,还可以在集群中找任意一台机器启动一个备用的master

bin/hbase-daemon.sh start master

新启的这个master会处于backup状态

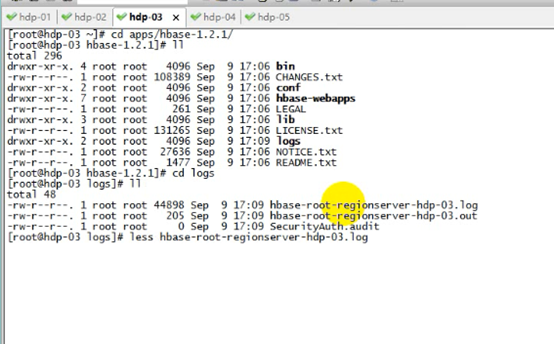

如果报错了,在这看错误,注意时间错误、

HBASE的对外端口是16010

同时也可以启动一个备用的master,在启动之后,随便在一台机器上,

Bin/hbase-daemon.sh start master

同时也可以试着访问这个页面

这hbase的系统表记录的是数据的索引表,记录哪个范围的数据储存在哪个regionserver

3. 启动hbase的命令行客户端

bin/hbase shell

Hbase> list // 查看表

Hbase> status // 查看集群状态

Hbase> version // 查看集群版本

1.1. HBASE表模型

hbase的表模型跟mysql之类的关系型数据库的表模型差别巨大

hbase的表模型中有:行的概念;但没有字段的概念

行中存的都是key-value对,每行中的key-value对中的key可以是各种各样,每行中的key-value对的数量也可以是各种各样

1.1.1. hbase表模型的要点:

1、一个表,有表名

2、一个表可以分为多个 列族 (不同列族的数据会存储在不同文件中)

3、表中的每一行有一个“ 行键 rowkey ”,而且行键在表中不能重复

4、表中的每一对kv数据称作一个cell

5、hbase可以对数据存储多个历史版本(历史版本数量可配置)

6、整张表由于数据量过大,会被横向切分成若干个 region (用rowkey范围标识),不同region的数据也存储在不同文件中

7、hbase会对插入的数据按顺序存储:

要点一:首先会按行键排序

要点二:同一行里面的kv会按列族排序,再按k排序

1.1. hbase命令行客户端操作

1.1.1.1. 建表:

create 't_user_info','base_info','extra_info'

表名 列族名 列族名

1.1.1.2. 插入数据:

hbase(main):011:0> put 't_user_info','001','base_info:username','zhangsan'

0 row(s) in 0.2420 seconds

hbase(main):012:0> put 't_user_info','001','base_info:age','18'

0 row(s) in 0.0140 seconds

hbase(main):013:0> put 't_user_info','001','base_info:sex','female'

0 row(s) in 0.0070 seconds

hbase(main):014:0> put 't_user_info','001','extra_info:career','it'

0 row(s) in 0.0090 seconds

hbase(main):015:0> put 't_user_info','002','extra_info:career','actoress'

0 row(s) in 0.0090 seconds

hbase(main):016:0> put 't_user_info','002','base_info:username','liuyifei'

0 row(s) in 0.0060 seconds

1.1.1.3. 查询数据方式一:scan 扫描

hbase(main):017:0> scan 't_user_info'

ROW COLUMN+CELL

001 column=base_info:age, timestamp=1496567924507, value=18

001 column=base_info:sex, timestamp=1496567934669, value=female

001 column=base_info:username, timestamp=1496567889554, value=zhangsan

001 column=extra_info:career, timestamp=1496567963992, value=it

002 column=base_info:username, timestamp=1496568034187, value=liuyifei

002 column=extra_info:career, timestamp=1496568008631, value=actoress

2 row(s) in 0.0420 seconds

1.1.1.4. 查询数据方式二:get 单行数据

hbase(main):020:0> get 't_user_info','001'

COLUMN CELL

base_info:age timestamp=1496568160192, value=19

base_info:sex timestamp=1496567934669, value=female

base_info:username timestamp=1496567889554, value=zhangsan

extra_info:career timestamp=1496567963992, value=it

4 row(s) in 0.0770 seconds

1.1.1.5. 删除一个kv数据

hbase(main):021:0> delete 't_user_info','001','base_info:sex'

0 row(s) in 0.0390 seconds

删除整行数据:

hbase(main):024:0> deleteall 't_user_info','001'

0 row(s) in 0.0090 seconds

hbase(main):025:0> get 't_user_info','001'

COLUMN CELL

0 row(s) in 0.0110 seconds

1.1.1.6. 删除整个表:

hbase(main):028:0> disable 't_user_info'

0 row(s) in 2.3640 seconds

hbase(main):029:0> drop 't_user_info'

0 row(s) in 1.2950 seconds

hbase(main):030:0> list

TABLE

0 row(s) in 0.0130 seconds

=> []

1.1. Hbase重要特性--排序特性(行键)

插入到hbase中去的数据,hbase会自动排序存储:

排序规则: 首先看行键,然后看列族名,然后看列(key)名; 按字典顺序

Hbase的这个特性跟查询效率有极大的关系

比如:一张用来存储用户信息的表,有名字,户籍,年龄,职业....等信息

然后,在业务系统中经常需要:

查询某个省的所有用户

经常需要查询某个省的指定姓的所有用户

思路:如果能将相同省的用户在hbase的存储文件中连续存储,并且能将相同省中相同姓的用户连续存储,那么,上述两个查询需求的效率就会提高!!!

做法:将查询条件拼到rowkey内

当我们创建一个表之后,按道理说应该是可以在hdfs里面查看到数据的。但是。。。。

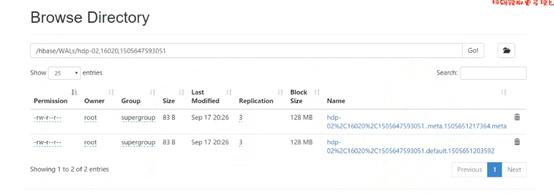

这里面没有数据,却能查到,那么数据到底存在哪呢,这些数据会存在内存中,这块内存空间叫做memstore,因为这样会快一点,他会把热数据放到这里面,就是刚刚访问过的数据,他会先放到内存中,但如果这时候宕机了怎么办,数据会丢吗,不会丢,他一方面会写数据,一方面会写日志,放在hdfs的日志目录里

当内存中写满了,就会写到hdfs里

可以试一下,当你停一下,你就会发现hdfs里面就有数据了

布隆过滤器的功能:判断一个数据以前是否出现过

布隆过滤器的原理:把一个数据通过算法转化成只有01的二进制数据,

然后用一个比较大的数组来存,每一个数据的01都存到这个数组里面,注意他们是相互叠加的比如一个数据1位置有1,3位置有1,另一个数据1位置有1,4位置有1,那么加入后就是1位置有1,3位置有1,4位置有1,如果再来一个数据的01,1位置有1,5位置有1,那么可以判断,这个数据是从来没有出现过的,

所以布隆过滤器一个可以判断出没有出现过的数据,

而他判断出出现过的数据却有可能是没出现过的。

他在HBASE的应用啊,比如说,region Server管理的一个表的列族,他的真实存放位置是hdfs,在hdfs的某个目录下。而且他这个列族文件不止一个,比如,当这个列族的数据改变的时候,他会生成一个新的文件,因为他没发修改hdfs里的文件,或者就算不改,列族里有许许多多的key,value,他们也会放在这个目录下的不同文件里面

每个文件都有个布隆过滤器,它是由这个文件kv的二进制值决定,当你要查询一个数据的话,他会先那这个数据的二进制值和某个文件的布隆过滤器比一下,如果匹配了,他就会找这个文件

关于java的一些api

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.hbase.HBaseConfiguration;

import org.apache.hadoop.hbase.HColumnDescriptor;

import org.apache.hadoop.hbase.HTableDescriptor;

import org.apache.hadoop.hbase.TableName;

import org.apache.hadoop.hbase.client.Admin;

import org.apache.hadoop.hbase.client.Connection;

import org.apache.hadoop.hbase.client.ConnectionFactory;

import org.apache.hadoop.hbase.regionserver.BloomType;

import org.junit.Before;

import org.junit.Test;

/**

*

* 1、构建连接

* 2、从连接中取到一个表DDL操作工具admin

* 3、admin.createTable(表描述对象);

* 4、admin.disableTable(表名);

5、admin.deleteTable(表名);

6、admin.modifyTable(表名,表描述对象);

*

* @author hunter.d

*

*/

public class HbaseClientDDL {

Connection conn = null;

@Before

public void getConn() throws Exception{

// 构建一个连接对象

Configuration conf = HBaseConfiguration.create(); // 会自动加载hbase-site.xml

conf.set("hbase.zookeeper.quorum", "hdp-01:2181,hdp-02:2181,hdp-03:2181,hdp-04:2181");

conn = ConnectionFactory.createConnection(conf);

}

/**

* DDL

* @throws Exception

*/

@Test

public void testCreateTable() throws Exception{

// 从连接中构造一个DDL操作器

Admin admin = conn.getAdmin();

// 创建一个表定义描述对象

HTableDescriptor hTableDescriptor = new HTableDescriptor(TableName.valueOf("user_info"));

// 创建列族定义描述对象

HColumnDescriptor hColumnDescriptor_1 = new HColumnDescriptor("base_info");

hColumnDescriptor_1.setMaxVersions(3); // 设置该列族中存储数据的最大版本数,默认是1

HColumnDescriptor hColumnDescriptor_2 = new HColumnDescriptor("extra_info");

// 将列族定义信息对象放入表定义对象中

hTableDescriptor.addFamily(hColumnDescriptor_1);

hTableDescriptor.addFamily(hColumnDescriptor_2);

// 用ddl操作器对象:admin 来建表

admin.createTable(hTableDescriptor);

// 关闭连接

admin.close();

conn.close();

}

/**

* 删除表

* @throws Exception

*/

@Test

public void testDropTable() throws Exception{

Admin admin = conn.getAdmin();

// 停用表

admin.disableTable(TableName.valueOf("user_info"));

// 删除表

admin.deleteTable(TableName.valueOf("user_info"));

admin.close();

conn.close();

}

// 修改表定义--添加一个列族

@Test

public void testAlterTable() throws Exception{

Admin admin = conn.getAdmin();

// 取出旧的表定义信息

HTableDescriptor tableDescriptor = admin.getTableDescriptor(TableName.valueOf("user_info"));

// 新构造一个列族定义

HColumnDescriptor hColumnDescriptor = new HColumnDescriptor("other_info");

hColumnDescriptor.setBloomFilterType(BloomType.ROWCOL); // 设置该列族的布隆过滤器类型

// 将列族定义添加到表定义对象中

tableDescriptor.addFamily(hColumnDescriptor);

// 将修改过的表定义交给admin去提交

admin.modifyTable(TableName.valueOf("user_info"), tableDescriptor);

admin.close();

conn.close();

}

/**

* DML -- 数据的增删改查

*/

}

import java.util.ArrayList;

import java.util.Iterator;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.hbase.Cell;

import org.apache.hadoop.hbase.CellScanner;

import org.apache.hadoop.hbase.HBaseConfiguration;

import org.apache.hadoop.hbase.TableName;

import org.apache.hadoop.hbase.client.Connection;

import org.apache.hadoop.hbase.client.ConnectionFactory;

import org.apache.hadoop.hbase.client.Delete;

import org.apache.hadoop.hbase.client.Get;

import org.apache.hadoop.hbase.client.Put;

import org.apache.hadoop.hbase.client.Result;

import org.apache.hadoop.hbase.client.ResultScanner;

import org.apache.hadoop.hbase.client.Scan;

import org.apache.hadoop.hbase.client.Table;

import org.apache.hadoop.hbase.util.Bytes;

import org.junit.Before;

import org.junit.Test;

public class HbaseClientDML {

Connection conn = null;

@Before

public void getConn() throws Exception{

// 构建一个连接对象

Configuration conf = HBaseConfiguration.create(); // 会自动加载hbase-site.xml

conf.set("hbase.zookeeper.quorum", "hdp-01:2181,hdp-02:2181,hdp-03:2181");

conn = ConnectionFactory.createConnection(conf);

}

/**

* 增

* 改:put来覆盖

* @throws Exception

*/

@Test

public void testPut() throws Exception{

// 获取一个操作指定表的table对象,进行DML操作

Table table = conn.getTable(TableName.valueOf("user_info"));

// 构造要插入的数据为一个Put类型(一个put对象只能对应一个rowkey)的对象

Put put = new Put(Bytes.toBytes("001"));

put.addColumn(Bytes.toBytes("base_info"), Bytes.toBytes("username"), Bytes.toBytes("张三"));

put.addColumn(Bytes.toBytes("base_info"), Bytes.toBytes("age"), Bytes.toBytes("18"));

put.addColumn(Bytes.toBytes("extra_info"), Bytes.toBytes("addr"), Bytes.toBytes("北京"));

Put put2 = new Put(Bytes.toBytes("002"));

put2.addColumn(Bytes.toBytes("base_info"), Bytes.toBytes("username"), Bytes.toBytes("李四"));

put2.addColumn(Bytes.toBytes("base_info"), Bytes.toBytes("age"), Bytes.toBytes("28"));

put2.addColumn(Bytes.toBytes("extra_info"), Bytes.toBytes("addr"), Bytes.toBytes("上海"));

ArrayList<Put> puts = new ArrayList<>();

puts.add(put);

puts.add(put2);

// 插进去

table.put(puts);

table.close();

conn.close();

}

/**

* 循环插入大量数据

* @throws Exception

*/

@Test

public void testManyPuts() throws Exception{

Table table = conn.getTable(TableName.valueOf("user_info"));

ArrayList<Put> puts = new ArrayList<>();

for(int i=0;i<100000;i++){

Put put = new Put(Bytes.toBytes(""+i));

put.addColumn(Bytes.toBytes("base_info"), Bytes.toBytes("username"), Bytes.toBytes("张三"+i));

put.addColumn(Bytes.toBytes("base_info"), Bytes.toBytes("age"), Bytes.toBytes((18+i)+""));

put.addColumn(Bytes.toBytes("extra_info"), Bytes.toBytes("addr"), Bytes.toBytes("北京"));

puts.add(put);

}

table.put(puts);

}

/**

* 删

* @throws Exception

*/

@Test

public void testDelete() throws Exception{

Table table = conn.getTable(TableName.valueOf("user_info"));

// 构造一个对象封装要删除的数据信息

Delete delete1 = new Delete(Bytes.toBytes("001"));

Delete delete2 = new Delete(Bytes.toBytes("002"));

delete2.addColumn(Bytes.toBytes("extra_info"), Bytes.toBytes("addr"));

ArrayList<Delete> dels = new ArrayList<>();

dels.add(delete1);

dels.add(delete2);

table.delete(dels);

table.close();

conn.close();

}

/**

* 查

* @throws Exception

*/

@Test

public void testGet() throws Exception{

Table table = conn.getTable(TableName.valueOf("user_info"));

Get get = new Get("001".getBytes());

Result result = table.get(get);

// 从结果中取用户指定的某个key的value

byte[] value = result.getValue("base_info".getBytes(), "age".getBytes());

System.out.println(new String(value));

System.out.println("-------------------------");

// 遍历整行结果中的所有kv单元格

CellScanner cellScanner = result.cellScanner();

while(cellScanner.advance()){

Cell cell = cellScanner.current();

byte[] rowArray = cell.getRowArray(); //本kv所属的行键的字节数组

byte[] familyArray = cell.getFamilyArray(); //列族名的字节数组

byte[] qualifierArray = cell.getQualifierArray(); //列名的字节数据

byte[] valueArray = cell.getValueArray(); // value的字节数组

System.out.println("行键: "+new String(rowArray,cell.getRowOffset(),cell.getRowLength()));

System.out.println("列族名: "+new String(familyArray,cell.getFamilyOffset(),cell.getFamilyLength()));

System.out.println("列名: "+new String(qualifierArray,cell.getQualifierOffset(),cell.getQualifierLength()));

System.out.println("value: "+new String(valueArray,cell.getValueOffset(),cell.getValueLength()));

}

table.close();

conn.close();

}

/**

* 按行键范围查询数据

* @throws Exception

*/

@Test

public void testScan() throws Exception{

Table table = conn.getTable(TableName.valueOf("user_info"));

// 包含起始行键,不包含结束行键,但是如果真的想查询出末尾的那个行键,那么,可以在末尾行键上拼接一个不可见的字节(/000)

Scan scan = new Scan("10".getBytes(), "10000/001".getBytes());

ResultScanner scanner = table.getScanner(scan);

Iterator<Result> iterator = scanner.iterator();

while(iterator.hasNext()){

Result result = iterator.next();

// 遍历整行结果中的所有kv单元格

CellScanner cellScanner = result.cellScanner();

while(cellScanner.advance()){

Cell cell = cellScanner.current();

byte[] rowArray = cell.getRowArray(); //本kv所属的行键的字节数组

byte[] familyArray = cell.getFamilyArray(); //列族名的字节数组

byte[] qualifierArray = cell.getQualifierArray(); //列名的字节数据

byte[] valueArray = cell.getValueArray(); // value的字节数组

System.out.println("行键: "+new String(rowArray,cell.getRowOffset(),cell.getRowLength()));

System.out.println("列族名: "+new String(familyArray,cell.getFamilyOffset(),cell.getFamilyLength()));

System.out.println("列名: "+new String(qualifierArray,cell.getQualifierOffset(),cell.getQualifierLength()));

System.out.println("value: "+new String(valueArray,cell.getValueOffset(),cell.getValueLength()));

}

System.out.println("----------------------");

}

}

}

- 本文标签: linux Hadoop 数据库 NOSQL API 遍历 dist 文件系统 Qualifier 服务器 tar sql 管理 HTML client IO ArrayList root HMaster 数据 App Connection Property 索引 apache https HRegionServer UI CTO 参数 connectionFactory 模型 ssh ip zookeeper Region 空间 list 删除 分布式系统 java shell HBase HBase Shell 时间 value http 分布式 目录 端口 HDFS 配置 需求 key DDL id mysql tab 集群 安装 代码 XML src Master junit

- 版权声明: 本文为互联网转载文章,出处已在文章中说明(部分除外)。如果侵权,请联系本站长删除,谢谢。

- 本文海报: 生成海报一 生成海报二

![[HBLOG]公众号](http://www.liuhaihua.cn/img/qrcode_gzh.jpg)